[사회] 한양대, 저조도 객체 탐지 기술 ‘ICLR 2026’ 채택

-

3회 연결

본문

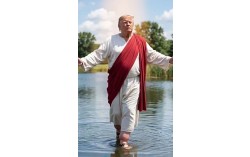

(좌측부터) 한양대 미래자동차공학과 신광익 학부생, 송재하 석사과정생, 황순민 교수

한양대학교 공과대학 미래자동차공학과 황순민 교수팀(IRCV 연구실)의 연구 성과가 인공지능(AI) 분야 세계 최고 권위 학회인 ‘ICLR 2026(International Conference on Learning Representations)’에 채택됐다고 밝혔다.

ICLR은 구글 스칼라(Google Scholar) 기준 공학·컴퓨터과학 분야 세계 3위(h5-index 362)에 해당하는 대표적인 학회다. 특히 이번 연구는 학부생이 제1저자로서 연구를 주도하고 석사과정생이 참여해 거둔 성과라는 점에서 학계의 주목을 받고 있다.

일반적인 객체 탐지 모델은 빛이 부족하고 노이즈가 심한 저조도 환경에서 객체의 경계나 특징 정보를 제대로 파악하지 못해 성능이 급격히 떨어진다. 기존에는 이를 해결하기 위해 이미지를 강제로 밝게 만들거나 도메인 적응 기법을 사용했으나, 노이즈가 함께 증폭되거나 추가적인 연산 비용이 발생하는 등 실제 자율주행 시스템에 적용하기에는 한계가 있었다.

황순민 교수 연구팀은 이러한 문제를 해결하기 위해 ‘자가 가이드형 저조도 객체 탐지 프레임워크(Self-guided low-light object detection framework)’를 제안했다. 이 기술은 모델이 저조도 이미지로부터 학습에 필요한 목표 이미지를 스스로 생성하고, 이를 통해 객체 탐지에 최적화된 특징을 학습하도록 유도하는 방식이다.

연구의 핵심은 이미지의 주파수 영역을 분리해 처리하는 ‘푸리에 기반 이미지 융합(Fourier-based image fusion)’ 기법이다. 이미지의 구조 정보를 담고 있는 ‘위상(Phase)’과 밝기·노이즈 정보를 포함하는 ‘진폭(Amplitude)’을 분리한 뒤 최적으로 결합함으로써, 형태적 특징은 유지하면서 노이즈만 효과적으로 억제한 학습 신호를 만들어낸다.

가장 큰 장점은 ‘실용성’이다. 이 복잡한 과정은 모델 학습 단계에서만 수행되며, 실제 자율주행차나 CCTV 등에서 작동하는 추론 단계에서는 추가 연산이나 파라미터 증가가 전혀 없다. 즉, 기존 모델과 동일한 속도를 유지하면서도 성능만 비약적으로 끌어올린 것이다.

실험 결과, 대표적인 저조도 데이터셋인 ‘DARK FACE’에서 기존 기술 대비 +16.9 mAP(mean Average Precision)라는 압도적인 성능 향상을 기록했다. 시각화 분석 결과에서도 제안 기법을 적용했을 때 AI가 배경과 객체를 훨씬 더 명확하게 구분하는 것이 확인됐다. 이를 통해 향후 야간 자율주행, 영상 감시 시스템, 보안 인식 등 다양한 산업 분야에 즉각 활용될 것으로 기대된다.

황순민 교수는 “앞서 CVPR 2025 Workshop ‘Waymo Vision-based End-to-End Driving’ 챌린지에서 3위를 이끈 주역들이 이번 ICLR 논문 게재까지 성공하며, 연구실의 독보적인 기술력을 입증했다”며 “앞으로도 실제 환경에 바로 적용 가능한 고성능 AI 기술 연구를 지속할 것”이라고 밝혔다.

이번 연구는 과학기술정보통신부의 지원을 받아 한국연구재단 글로벌선도연구센터지원사업(IRC)의 일환으로 수행됐으며, 한양대 Beyond-G 글로벌 혁신센터가 추진하는 미래 융합기술 연구 방향성과 연계되어 진행됐다.

해당 논문 「Self-Guided Low Light Object Detection Framework」에는 한양대 미래자동차공학과 신광익 학부생이 제1저자, 송재하 석사과정생이 제2저자, 황순민 교수가 교신저자로 참여했으며, 본 논문은 4월 25일 브라질 리우데자네이루에서 개최 예정인 ICLR 2026 학회에서 발표될 예정이다.

댓글목록 0