[경제] 얼굴·목소리·회사까지 복제하는 AI…범죄의 무기가 되다 [트랜D]

-

2회 연결

본문

지난 3월, 전 세계 개발자들이 주로 사용하는 소프트웨어 엑시오스(Axios)가 해킹됐다. 해커는 먼저 실존하는 기업의 신원을 통째로 복제했다. 로고와 브랜딩을 입힌 업무 메신저 채널, 가짜 팀원 프로필, 화상회의까지 정교하게 꾸몄다. 이들을 만난 관리자는 “모든 것이 극도로 전문적이었다”고 회고했다. 가짜 회의에서 프로그램 설치를 유도한 뒤, 탈취한 계정으로 악성 코드가 숨겨진 새 버전을 전 세계에 배포했다. 3시간 만에 삭제됐지만, 그사이 수많은 컴퓨터가 감염됐다. 배후는 바로 북한 해킹 그룹. 이처럼 가짜 회사를 통째로 만들어 소프트웨어를 공격하는 시대가 도래한 것이다.

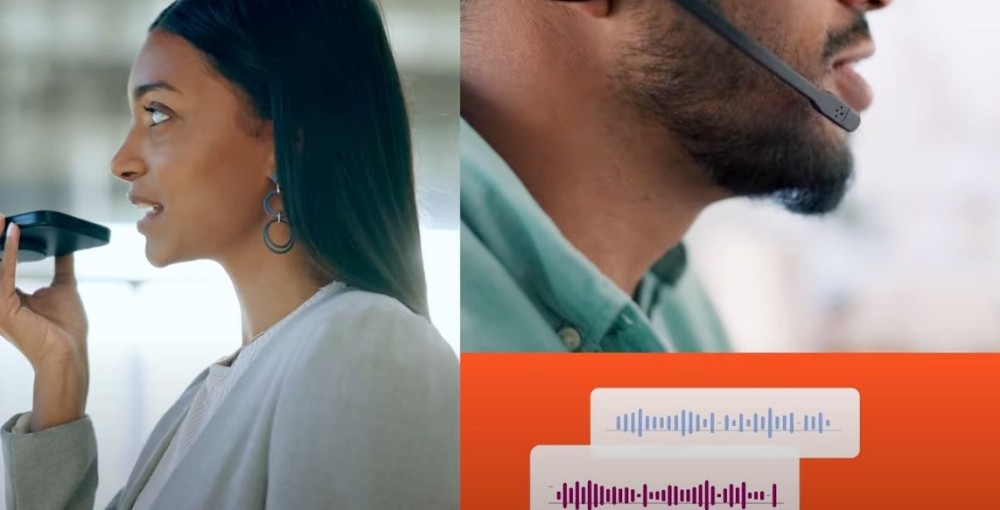

MIT 테크놀로지 리뷰는 올해 10대 AI 트렌드 중 하나로 '초강력 사기'를 꼽았다. 생성형 AI와 딥페이크를 활용한 사기 피해는 꾸준히 늘어나는 추세다. 사진 아토믹 메일

AI가 낮춘 범죄의 문턱

미국의 과학분석 잡지 MIT 테크놀로지 리뷰는 올해 10대 인공지능(AI) 트렌드 중 하나로 ‘초강력 사기(Supercharged Scams)’를 선정했다. 더는 미래의 위협이 아니라 현재의 위기라는 뜻이다. 숫자가 이를 증명한다. 미 연방수사국(FBI)은 지난해 인터넷범죄보고서에서 사상 처음으로 ‘AI 사기’를 별도 카테고리로 분류하며, 미국 내 생성형 AI 관련한 사기 피해가 2023년 123억 달러(약 18조3700억원)에서 27년 400억 달러(약 59조7400억원)로 급증할 것으로 전망했다. 블록체인 분석 기업 제이널리시스에 따르면 AI를 활용한 사기의 수익률은 전통 사기 대비 4배 이상이다.

엑시오스를 해킹한 북한 그룹 UNC1069의 규모는 이 위협의 수준을 보여준다. 이들은 지난해 1월 이후 주요 개발자 생태계에 1700개 이상의 악성 프로그램을 유포했고 협업 도구나 화상 채팅 서비스를 복제해 가짜 웹사이트를 대거 운영했다. 국가 차원의 조직이 AI 도구를 활용해 소프트웨어 공급망을 체계적으로 노리고 있는 것이다.

개인 범죄자도 예외가 아니다. 미국 코넬대가 24년 진행한 연구에 따르면 AI가 작성한 피싱 메일 클릭률은 사람이 쓴 것보다 4배 이상 높다. 문법 오류나 어색한 표현 같은 전통적인 경고 신호가 사라졌기 때문이다. 최근 AI가 작성한 피싱 메일은 누가 봐도 진짜 사람이 쓴 것 같은 메일 제목과 내용으로 무장하고 있다. 세계경제포럼(WEF)은 지난해 전 세계 조직의 73%가 사이버 사기 피해를 경험했다고 밝혔다.

AI 기반 범죄 진입 장벽은 바닥까지 떨어졌다. 다크 웹에서는 딥페이크(Deepfake) 제작 도구가 20달러(약 2만9000원)부터 판매되고, 월 구독료만 내면 누구나 가짜 영상을 만들 수 있는 ‘서비스형 딥페이크(DaaS)’까지 등장했다. 예전에는 해킹에 수년 간의 기술 훈련이 필요했다면 이제는 AI가 전문 개발자 대신 코드를 짜고 피싱 메일을 쓰고, 타깃의 목소리를 복제한다.

AI 기반 범죄의 진입 장벽은 점차 낮아지고 있다. 월 구독료를 내면 가짜 영상을 만들 수 있는 '서비스형 딥페이크(DaaS)'까지 등장했다. 사진 셔터스톡

인터폴은 범죄 조직들이 저렴한 AI 도구를 대거 도입해 더 많은 피해자를 빠르게 겨냥하며, 단속이 시작되면 거점을 신속히 이동하고 있다고 경고했다. AI 성능이 급격하게 좋아지고 전문 개발자가 아니어도 활용할 수 있게 되자, 이를 악용한 범죄가 빠르게 늘고 있는 셈이다.

딥페이크부터 로맨스 스캠까지

AI 범죄의 스펙트럼은 놀라울 정도로 넓다. 딥페이크를 사용해 직원들에게 금전을 갈취하는 등의 사건이 꾸준히 발생하고 있다. 24년 2월, 영국 엔지니어링 회사 아럽의 홍콩지사 직원이 화상회의에 참석했다. 화면에는 본사의 최고재무관리자(CFO)와 동료들이 보였다. 피해 직원은 딥페이크에 당해 지시에 따라 2500만 달러(약 373억원)를 송금했다. 회의에 참석한 진짜 사람은 그 한명 뿐이었고, 나머지는 전부 AI가 만든 가짜 영상이었다.

같은 해 7월에는 페라리 최고경영자(CEO) 목소리를 AI로 복제해 고위 임원에게 전화한 사건도 있었다. 이탈리아 남부 억양까지 정교하게 재현한 가짜 목소리가 기밀 인수 건을 내세워 긴급 자금 이체를 요구했다. 딥페이크 구독 서비스를 이용한 범죄 조직이 한 기업 임원을 사칭해 직원들에게 수백만 달러를 이체하도록 지시한 사건도 발생했다.

대형언어모델(LLM)을 활용해 수십 명의 피해자와 동시에 연애하는 AI 기반 로맨스 스캠도 등장했다. 각 피해자의 성격에 맞춰 대화 톤을 바꾸고, 감정적 유대를 쌓은 뒤 돈을 송금하도록 유도한다. 딥페이크 음성 사기는 AI 발전과 맞물려 급증했다. 국내에서도 보이스피싱 피해가 심각하다. 지금도 가족이나 수사기관을 사칭하는 전화에 많은 사람이 속고 있다. 실제 가족 목소리를 복제한 전화, 실제 직장 상사의 얼굴이 나오는 화상회의까지 결합한다면 피해 규모는 지금과 차원이 달라질 수밖에 없다.

가장 효과적인 방어

물론 방어 기술도 빠르게 진화하고 있다. 미국 보안 회사 핀드롭은 1억 달러의 자금을 확보하고 실시간 딥페이크 탐지 시스템을 개발 중이다. 특히 화상회의에서 참석자의 영상과 음성이 진짜인지 실시간으로 판별하는 기술을 만들고 있다. 비제이 발라수브라마니안(VijayBalasubramaniyan) 핀드롭 CEO는 “2023년 초에는 딥페이크 공격이 고객당 한 달에 한 건 정도였다면, 지금은 하루에 7건”이라고 밝혔다.

핀드롭은 딥페이크와 AI 범죄를 방지하는 음성인증 기술을 개발 중이다. 화상회의 참석자의 영상과 음성이 진짜인지 실시간으로 판별하는 기술을 만들고 있다. 사진 핀드롭 홈페이지

미국의 보안 기업 리얼리티 디펜더는 화상회의에 플러그인 형태로 탑재하는 딥페이크 탐사 엔진을 개발했다. 탐지 엔진은 딥페이크를 실시간 탐지하며, 블록체인 기반 신원 인증 시스템과 결합해 신원 위조를 원천 차단한다. 법적 증거로 활용 가능한 포렌식 보고서도 자동으로 생성한다. 리얼리티 디펜더는 영상과 음성 등 여러 데이터를 동시에 분석하는 탐지 엔진으로 수십만 건 이상의 딥페이크를 탐지했다.

그러나 기술만으로는 한계가 분명하다. 인간이 자체적으로 고품질 딥페이크를 식별하는 정확도는 아직 24.5%에 불과하다. AI 탐지 도구조차 실험실 밖 실전 환경에서는 정확도가 절반 가까이 떨어진다. 흥미로운 건 앞서 언급한 페라리 사건이다. CEO 음성을 복제한 공격을 무력화한 것은 AI도, 보안 솔루션도 아니었다.

피싱 대상자였던 고위 임원이 “우리가 지난주에 이야기한 책이 무엇이냐”고 개인적인 질문을 던지자 공격자가 전화를 끊었다. 수십억 원짜리 AI 음성 복제 기술을 막은 것은 사람과 사람 사이의 맥락이었다. AI는 얼굴과 목소리는 복제할 수 있지만 두 사람 사이에만 존재하는 기억까지는 복제하지 못했다. 최첨단 공격의 효과적인 방어책이 가장 원시적인 방법이라는 역설이다. AI가 얼굴, 목소리, 심지어 회사까지 통째로 복사하는 시대에도 마지막 방어선은 결국 사람의 판단이다.

댓글목록 0